J’observe un changement. L’intelligence artificielle n’est plus l’apanage des supercalculateurs. L’IA légère change la donne. Elle désigne des modèles d’IA optimisés pour l’efficacité. Ils fonctionnent sur des appareils modestes : téléphones, capteurs IoT, équipements de périphérie.

Fini les modèles géants, les “frontières” qui demandent des fermes de serveurs. Ces petits modèles, ces “compacts”, se concentrent sur des tâches précises. Ils minimisent la mémoire et la consommation d’énergie. C’est l’avenir, une IA partout, pour tous.

Le tour de magie : Mes techniques favorites pour une IA légère

Rendre l’IA légère, c’est un art. Nous utilisons des méthodes d’optimisation spécialisées.

- L’élagage (Model Pruning) : J’enlève les neurones ou connexions superflues. Cela réduit la taille du réseau. La performance ne souffre pas. C’est comme tailler un arbre pour le rendre plus robuste.

- La quantification (Quantization) : Je réduis la précision des nombres. Par exemple, de 32 bits à 8 bits. Le fichier diminue. Les calculs s’accélèrent. C’est un gain énorme.

- La distillation des connaissances (Knowledge Distillation) : J’entraîne un petit modèle “étudiant”. Il imite le comportement d’un grand modèle “enseignant”. Le petit apprend les astuces du grand.

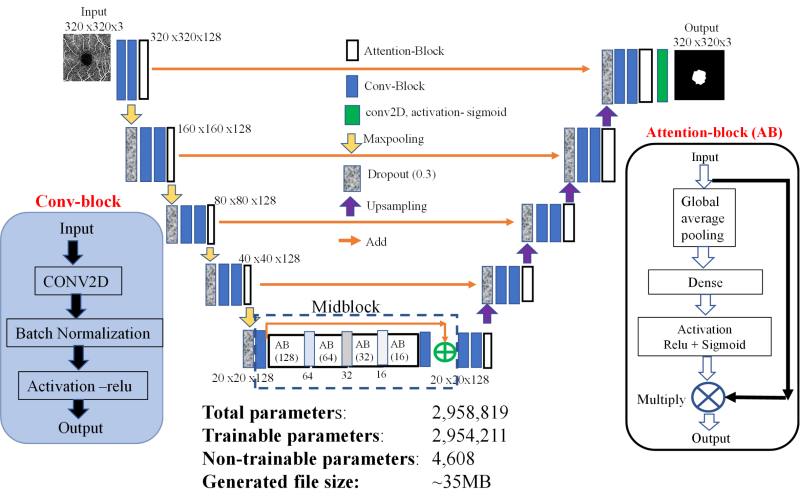

- L’optimisation architecturale (Architectural Optimization) : J’emploie des structures efficaces. Pensez à MobileNet ou TinyML. Elles sont conçues pour le matériel à faible consommation.

Mes compagnons de route : Exemples de modèles légers (2025–2026)

Plusieurs entreprises technologiques offrent ces versions allégées. Je les vois partout.

- Meta Llama 3.2 (1B/3B) : Pensé pour le mobile. Il résume, il suit des instructions. Directement sur votre téléphone.

- Google Gemini 3 Flash, Gemma 3 & Gemma 4 : Efficaces, rapides. Ils sont parfaits pour la faible latence.

- Microsoft Phi Series : Des petits modèles, souvent moins de 3 milliards de paramètres. Ils sont étonnamment bons en raisonnement.

- FLUX1.1 [dev] : Un modèle léger de génération d’images. Il donne des visuels de haute qualité. Le coût de calcul est bas.

Pourquoi j’aime l’IA légère : Ses nombreux avantages

Elle apporte des bénéfices concrets. Je les vois chaque jour.

- Confidentialité : Les données sont traitées localement. Pas d’envoi vers un serveur cloud. C’est la garantie de votre vie privée.

- Faible latence : Les réponses sont presque instantanées. Pas d’attente pour le voyage des données.

- Coût réduit : Les entreprises économisent sur l’hébergement GPU. Elles utilisent le matériel des utilisateurs. C’est malin.

- Accès hors ligne : Ces modèles travaillent sans connexion internet. Pratique dans les zones reculées.

Le terrain de jeu : Mon matériel de prédilection pour l’IA légère

Les modèles légers tournent sur un large éventail de matériel. Des appareils grand public aux micro-puces ultra-basse consommation. Ils n’ont pas besoin de centres de données gigantesques. Ils fonctionnent “sur l’appareil”.

Électronique grand public

Les appareils personnels modernes gèrent de petits modèles. Je pense à Llama 3.2 1B ou Gemma 2B.

- Smartphones et tablettes : Les puces mobiles haut de gamme (Apple A-series, Qualcomm Snapdragon avec accélérateurs IA) gèrent la traduction en temps réel ou l’édition d’images.

- Ordinateurs portables et de bureau :

- Apple Silicon Macs : C’est ma plateforme favorite. La mémoire unifiée permet au GPU d’accéder à beaucoup de RAM pour l’inférence.

- NVIDIA GPUs : Les cartes de bureau, comme la NVIDIA RTX 4060 Ti 16 Go, sont le “point idéal” pour les amateurs d’IA locale.

- CPUs modernes : Des processeurs comme Intel Core i7/i9 ou AMD Ryzen 7/9 gèrent des modèles de 7 à 13 milliards de paramètres. Mais c’est plus lent qu’un GPU.

Edge Computing et ordinateurs monocartes

Ces appareils sont pour l’IA “toujours active”. Pensez à la robotique, aux maisons intelligentes, à la surveillance industrielle.

- NVIDIA Jetson Series : Des modules spécialisés. Le Jetson Orin Nano ou Jetson AGX Orin. C’est la norme industrielle pour l’IA de périphérie haute performance. Jusqu’à 275 TOPS.

- Raspberry Pi 5 : Il exécute des modèles légers. Surtout avec un accélérateur comme le module Hailo-8 AI. Il atteint 26 TOPS.

- Google Coral : Il utilise un Edge TPU. Optimisé pour l’inférence TensorFlow Lite ultra-rapide, avec très peu de puissance.

Microcontrôleurs ultra-basse consommation (TinyML)

Pour les tâches les plus contraintes. Des déclencheurs vocaux simples, la surveillance de capteurs. Les modèles “TinyML” tournent sur du matériel avec des kilo-octets de mémoire seulement.

- ESP32 Series : Des microcontrôleurs populaires, peu coûteux. Ils intègrent Wi-Fi et Bluetooth. Ils gèrent le traitement d’image de base ou la reconnaissance vocale.

- ARM Cortex-M Series : Dans les montres intelligentes, les trackers de fitness. Ils traitent les données biométriques localement.

- Arduino Nano : Il supporte de petits frameworks. TensorFlow Lite Micro, par exemple. Pour la détection de gestes ou de sons de base.

Résumé des spécifications matérielles courantes

Je vous ai préparé un petit tableau. C’est pratique.

| Catégorie de matériel | Mémoire typique | Idéal pour |

|---|---|---|

| Microcontrôleurs | < 1 Mo | Capteurs, déclencheurs vocaux, wearables |

| SBCs de périphérie (Edge SBCs) | 4 Go – 16 Go | Robotique, caméras intelligentes, LLMs de 7B |

| PCs grand public | 16 Go – 64 Go | Assistants de codage, chatbots privés |

| Prosumer/Workstations | 64 Go – 128+ Go | Grands LLMs locaux (30B+), fine-tuning |

Le grand virage : Rapport sur l’IA légère et les SLM (2026)

Les rapports sur l’IA légère annoncent un mouvement massif. Vers le “TinyML” et les Small Language Models (SLMs). Les entreprises priorisent le coût, la confidentialité et la vitesse. Elles délaissent la puissance brute des systèmes gourmands en GPU. Les données de 2026 montrent des latences inférieures à 100 ms pour ces modèles. Contre 200 à 500 ms pour l’IA basée sur le cloud. Cela réduit les coûts opérationnels de 70 à 90 %. C’est un fait, le monde change.

Les moteurs du marché et les tendances

Le mouvement est clair.

- Le virage “On-Device” : L’IA légère déplace l’intelligence. Directement vers les “appareils de périphérie”. Smartphones, caméras intelligentes, capteurs IoT. Plus besoin de connexion cloud constante. La confidentialité de l’utilisateur s’améliore. Le traitement se fait localement.

- L’efficacité avant la taille : Des modèles comme Phi-3-mini de Microsoft sont 10 fois moins chers. Leurs capacités sont similaires à celles de modèles plus généralistes. C’est une révélation.

- Techniques d’optimisation : Des rapports de Nature et MDPI soulignent la quantification, l’élagage, la distillation des connaissances. Ce sont les méthodes clés. Elles réduisent la taille des modèles. Sans perte de performance.

Top modèles légers (2025–2026)

Voici ceux qui marquent le pas.

| Famille de Modèles | Caractéristiques Clés | Cas d’Utilisation Principal |

|---|---|---|

| Llama 3.2 (1B/3B) | Très mobile-friendly ; utilise l’élagage. | Assistants personnels, génération de texte sur tablettes. |

| Microsoft Phi-3 | Coût radicalement plus bas ; optimisé pour les GPUs. | Automatisation de tâches d’entreprise, raisonnement localisé. |

| Mistral 7B | Excellent rapport performance-taille. | Codage général et raisonnement sur du matériel grand public. |

| Tiny YOLOv4 | Jusqu’à 98 % de précision pour la détection d’objets. | Surveillance visuelle en temps réel (ex. compteurs d’eau). |

Applications industrielles

Je les vois partout.

- Santé : Des modèles légers affinés. Pour le conseil en santé mentale, avec empathie.

- Agriculture : Pour une agriculture résiliente au climat. Prédire les besoins en irrigation. 90,1 % de précision sur des capteurs à faible mémoire.

- Aviation et fabrication : Maintenance prédictive en temps réel. Surveillance de la sécurité. Pour réduire l’erreur humaine.

- Réseautage : Des modèles d’IA hiérarchiques. Ils détectent les anomalies réseau localement. Réduction de la latence dans les environnements 5G.

Défis actuels

Malgré la croissance, des rapports techniques soulignent des compromis. Entre la précision du modèle et la vitesse de traitement. Sécuriser et mettre à jour des modèles décentralisés. Sur des milliers d’appareils de périphérie.

Cela reste un obstacle majeur. Le paysage de l’IA légère en 2026 évolue. Vers l’IA “Agentique” et “Physique”. Les modèles ne répondent pas seulement. Ils agissent. Dans le monde physique, comme des collègues numériques autonomes.

Maîtrisez l’IA. Une Compétence à la Fois.

DeepSkill Newsletter

Jalons récents du marché et de la performance

Le marché de l’IA de périphérie atteindra environ 30 milliards de dollars fin 2026. Une croissance de plus de 21 % par an.

- Rentabilité : Faire fonctionner un SLM de 7B est 10 à 30 fois moins cher. Que les LLMs traditionnels basés sur le cloud. Cela réduit souvent les dépenses d’entreprise jusqu’à 75 %.

- Latence : Les SLMs sur appareil répondent généralement en moins de 100 ms. Un seuil critique pour les applications mobiles et IoT en temps réel.

- Économies d’énergie : Les nouvelles architectures hybrides. Elles combinent de grands systèmes avec des modules spécifiques. Elles montrent des réductions d’énergie allant jusqu’à 40 %.

Les “petits” modèles de pointe émergents (début 2026)

Au-delà des séries Phi et Llama, de nouveaux modèles légers gagnent du terrain.

- DeepSeek-R1 Distilled (1.5B–70B) : Sorti début 2025. Ces modèles fonctionnent sur des appareils légers. Ils maintiennent des capacités de raisonnement avancées.

- Gemma 3 (270M) : Décrit comme “assez léger pour tourner sur un grille-pain”. Ce modèle de Google DeepMind vise le matériel à très faible consommation.

- Falcon H1R 7B : Un “expert en mathématiques” spécialisé. Un modèle de raisonnement. Conçu pour la périphérie.

- Nemotron Nano (8B/30B) : Un modèle NVIDIA unique. Il supporte une longueur de contexte d’un million de jetons. Sur du matériel grand public.

- Jamba Reasoning 3B : Un modèle léger d’AI21 Labs. Il surpasse son poids en matière de raisonnement.

Au-delà du rétrécissement : Techniques d’optimisation de nouvelle génération

Je vois les chercheurs aller plus loin. Plus juste “réduire”. Ils utilisent des approches mathématiques avancées.

- CompreSSM : Développé par le MIT CSAIL et Liquid AI. Cette technique compresse les modèles d’espace d’état. Pendant l’entraînement. Elle identifie et supprime le “poids mort” tôt.

- Modèles 1.58-bit (BitNet) : Cette technologie utilise des poids ternaires (-1, 0, 1). Les modèles deviennent drastiquement plus petits. Ils restent étonnamment capables.

- TurboQuant : Présenté à l’ICLR 2026. Cet algorithme gère la surcharge mémoire dans la quantification vectorielle. Il débloque les goulots d’étranglement de performance. Pour la recherche sur appareil.

Adoption industrielle spécialisée

Le focus a bougé. Des bots généralistes à l’infrastructure invisible.

- Fabrication prédictive : L’IA Apollo d’Hexagon utilise la reconnaissance de formes. Pour prévoir la santé des équipements en temps réel. Elle prévient les dérives de calibration au micron près.

- Soins de santé d’urgence : Les outils ECG basés sur l’IA (comme la “Queen of Hearts”). Ils identifient les blocages cardiaques avec 84 % de précision. C’est le double de la performance humaine standard. Dans les cas ambigus.

- Préservation culturelle : La plateforme LORYA utilise une IA spécialisée. Pour numériser des manuscrits écrits à la main et des textes historiques. L’OCR standard ne peut pas les traiter.

Moteurs et tendances clés du marché (2026–2027)

Le marché de l’IA légère en 2026 est propulsé par un changement fondamental. D’une “IA Générale” massive et centralisée. Vers des systèmes spécialisés et localisés. Ils privilégient l’efficacité opérationnelle et la souveraineté des données.

Principaux moteurs du marché

- Réductions des coûts opérationnels : Les entreprises adoptent des modèles hybrides. Pour éviter l’incertitude financière des prix basés sur les jetons. Les SLM sont 10 à 30 fois moins chers. Que les LLMs traditionnels basés sur le cloud.

- Confidentialité et exigences réglementaires : Des lois strictes sur la résidence des données (comme le GDPR). La montée de l'”IA Souveraine”. Elles obligent les industries à traiter les données sensibles localement. Pensez à la finance et à la santé.

- Exigences de faible latence : Les applications en robotique, véhicules autonomes et diagnostics médicaux. Elles nécessitent des temps de réponse inférieurs à 100 ms. La connectivité cloud ne peut pas toujours les fournir de manière fiable.

- Contraintes énergétiques : Les grands centres de données font face à des goulots d’étranglement croissants. En termes de puissance et de refroidissement. L’IA légère offre une alternative durable. Elle déplace les charges de travail vers des appareils de périphérie économes en énergie.

Tendances clés pour 2026–2027

Je vois de grandes évolutions.

- Montée des systèmes de périphérie “agentiques” : L’IA évolue. Des simples chatbots vers des agents autonomes. Capables d’accomplir des tâches complexes. Planification de projets, maintenance automatisée. Directement sur des puces de périphérie contraintes.

- Dominance des SLM spécialisés : 2026 est “l’année du SLM”. Des modèles spécifiques (souvent moins de 5 milliards de paramètres). Ils surpassent les géants généralistes. Dans des tâches de domaine spécifique. Codage, analyse médicale.

- Expansion de l’IA physique : L’intelligence s’incruste dans les systèmes physiques. Des robots humanoïdes sur les chaînes de fabrication automobile. L'”IA spatiale” interprète et vérifie les conditions physiques sur site. En temps réel.

- Infrastructure IA hybride : Une nouvelle “base de référence”. Le cloud public pour l’entraînement lourd. Des modèles d’inférence légers poussés vers la périphérie.

- Matériel grand public spécifique à l’IA : Les fonctionnalités basées sur l’IA sont standard. Dans les smartphones phares, les “AI PCs” émergents (plus de 40 TOPS). Redéfinir les attentes des consommateurs. Confidentialité et vitesse.

Projections du marché

Les chiffres sont parlants.

- Marché de l’IA sur appareil : Environ 17,6 milliards de dollars en 2025. Projeté à 115,7 milliards d’ici 2033. Un TCAC de 26,5 %.

- Marché des petits modèles linguistiques (SLM) : Devrait atteindre 11 milliards de dollars en 2026. Près de doubler à 22,5 milliards d’ici 2030.

- Marché mondial des puces d’IA de périphérie : Prévision de dépasser les 80 milliards de dollars d’ici 2036.

Mes préférés : Classement des modèles légers (2025–2026)

Les meilleurs modèles d’IA légère. Ils sont définis par un raisonnement haute performance. Sur un nombre de paramètres extrêmement faible. Souvent, ils permettent une latence inférieure à 100 ms. Sur des appareils grand public : smartphones, ordinateurs portables.

Classement des meilleurs modèles légers (2025–2026)

Mon top du top.

| Famille de Modèles | Statistiques de Performance Clés | Meilleur Cas d’Utilisation |

|---|---|---|

| GPT-5-mini / nano | État de l’art pour le déploiement en périphérie ; version “nano” compacte disponible pour le matériel très contraint. | Applications mobiles nécessitant une haute précision et une faible utilisation des ressources. |

| Phi-3.5 Mini (3.8B) | ~45ms de latence sur iPhone ; score MMLU d’environ 78 %. | Agents à faible latence et copilotes mobiles locaux. |

| Llama 4 (Small) | Sorti en avril 2025 ; multimodal-native ; conçu pour faire une pause et raisonner avant de répondre. | Raisonnement logique complexe et tâches multimodales sur appareil. |

| Gemma 3 (270M) | Extrêmement léger ; décrit comme “capable de tourner sur un grille-pain” en raison des exigences matérielles ultra-faibles. | Tâches IoT simples et applications clientes mobiles à haute vitesse. |

| DeepSeek-R1 Distill (1.5B–8B) | La variante 8B égale des modèles massifs de plus de 200B sur des benchmarks de raisonnement spécifiques ; supporte un contexte de 128k. | Raisonnement profond à coût contraint et logique complexe. |

| Qwen 2.5 Coder (7B) | Latence inférieure à 100 ms ; classé comme un “choix de premier ordre” pour l’autocomplétion de code locale. | Développement local et assistants de code auto-hébergés. |

Leaders émergents spécialisés

- OpenAI o3-mini : Un “modèle de raisonnement” spécialisé. Sorti début 2025. Il offre une résolution de problèmes de haut niveau. À un coût nettement inférieur aux modèles phares.

- Mistral Small 3.2 : Un modèle de 23,6 milliards de paramètres (souvent quantifié à environ 11 Go). Fréquemment recommandé pour l’équilibre entre la qualité du langage naturel et l’efficacité locale.

- Nemotron-3-Nano (30B) : Remarqué pour être plus rapide que les modèles concurrents. Dans les tâches à contexte long. Tout en fonctionnant sur des combinaisons de RAM/VRAM grand public.

- GLM-4-9B : Idéal pour l’appel de fonctions et l’écriture basée sur la recherche. Sur les appareils de périphérie. Il hérite de la logique de la série GLM-4 plus grande.

Guide de sélection de déploiement

Un petit conseil pour choisir.

- Pour Mobile/Edge (iPhone/Android) : Priorisez Phi-3.5 Mini ou Gemma 3 (270M). Pour la latence la plus basse possible (30–45ms).

- Pour les ordinateurs portables standards (8 Go–16 Go de RAM) : Utilisez Llama 3.2 (3B) ou Mistral Small avec quantification 4 bits (Q4). Pour un assistant hors ligne fiable.

- Pour les stations de travail locales haute performance : DeepSeek-V3.2 et Qwen 3.5 sont les familles largement recommandées. Pour un équilibre entre puissance et vitesse locale.

L’IA légère au cœur de l’industrie : Mes applications pratiques (2026)

En 2026, l’IA légère n’est plus une expérience. C’est une “infrastructure opérationnelle” critique. Partout, dans les industries mondiales. Le focus s’est déplacé. Vers l’IA Physique. L’intelligence est intégrée directement au matériel de première ligne. Pour des actions autonomes. Presque en temps réel. Sans dépendance au cloud.

Principales applications industrielles (2026)

Je vois des transformations.

Santé et sciences de la vie

La santé est un leader. 91 % des fournisseurs et payeurs étendent l’utilisation de l’IA en 2026.

- Surveillance à distance des patients (RPM) : Les dispositifs portables et les patchs médicaux utilisent TinyML. Pour traiter la fréquence cardiaque, le glucose, les niveaux d’oxygène localement. Ils alertent les patients seulement en cas de seuils dangereux. La confidentialité et la faible latence sont garanties.

- Documentation clinique : Les outils d’IA générative intégrés. Dans les plateformes de dossiers de santé électroniques (DSE). Ils utilisent l'”écoute ambiante”. Pour rédiger des résumés de patients. Des notes cliniques. En temps réel.

- Imagerie diagnostique : Les appareils portables avec IA intégrée. Ils fournissent un support diagnostique instantané. Pour les cliniciens. Identifient des conditions comme les blocages cardiaques. Avec une précision nettement plus élevée. Que les méthodes traditionnelles.

Commerce de détail et consommation

Plus de 90 % des leaders IT du commerce de détail priorisent l’IA. C’est leur top pour 2026.

- Opérations de magasin autonomes : Les agents IA résolvent jusqu’à 80 % des problèmes de service client. Ils gèrent la tarification dynamique. La prévision de la demande. Directement au niveau du magasin.

- Inventaire intelligent : Des systèmes comme ceux d’Amazon. Ils utilisent l’IA de périphérie. Pour une visibilité des stocks en temps réel. Des paiements sans caissier. Réduisant les ruptures de stock de 30 %.

- Hyper-personnalisation : Les détaillants utilisent des modèles sur appareil. Pour des recommandations de produits personnalisées. Des promotions. Sans envoyer les données sensibles sur le comportement des consommateurs vers le cloud.

Fabrication et automatisation industrielle

L’IA légère est la base des usines intelligentes. Elle réduit les temps d’arrêt. Le gaspillage. Grâce à l’autonomie décentralisée.

- Maintenance prédictive : L’IA sur appareil analyse les vibrations et la température. Dans les machines industrielles. Elle identifie les pannes potentielles. Avant qu’elles ne surviennent. Cela prévient les arrêts de production coûteux.

- Collaboration homme-robot : Les robots collaboratifs (cobots) utilisent des modèles de vision et de langage. Pour assister les travailleurs. Assemblage, manutention de matériaux. Tout en assurant la sécurité sur site.

- Jumeaux numériques : Les simulations opérationnelles en temps réel. Elles permettent aux usines de tester les décisions localement. Avant de les implémenter sur la ligne de production physique.

Agriculture et surveillance environnementale

TinyML est crucial pour l’agriculture de précision. Il permet une agriculture intelligente. Sur des capteurs à faible consommation. Alimentés par batterie.

- Surveillance des cultures sur nœud : Des capteurs de sol à énergie solaire. Ils analysent les motifs d’humidité et de nutriments. Au niveau de la plante. Pour optimiser l’utilisation de l’eau et des engrais.

- Santé du bétail : Des boucles d’oreille portables. Des colliers. Ils traitent les données physiologiques localement. Pour détecter les premiers signes de maladie. Même dans les zones reculées. Sans internet.

- Détection des maladies en temps réel : Des outils d’imagerie portables. Ils identifient les parasites et maladies des plantes. Instantanément sur le terrain. Pour une intervention immédiate.

Impact économique et stratégique

Les chiffres parlent d’eux-mêmes.

- Revenus et économies : 89 % des détaillants déclarent que l’IA augmente leur chiffre d’affaires annuel. 95 % affirment qu’elle diminue activement les coûts opérationnels.

- Productivité : Dans le seul secteur de la santé. L’IA administrative devrait générer 200 à 360 milliards de dollars d’économies annuelles d’ici 2026.

- Dominance de la périphérie : Environ 75 % de toutes les données IoT sont maintenant traitées à la périphérie. Plutôt que dans le cloud. Pour répondre aux exigences strictes de latence et de confidentialité.

Le revers de la médaille : réserves sur l’IA légère

L’IA légère offre vitesse et efficacité. Mais elle a aussi des compromis. Elle est moins adaptée aux tâches à enjeux élevés. Ou aux tâches très ouvertes. Comparée à ses homologues plus grands.

Red Hat nous rappelle : “Parce qu’ils ont moins de paramètres, les modèles légers ont souvent du mal avec les tâches qui nécessitent un large éventail de connaissances générales.”

1. Compromis performance et précision

C’est une réalité que je ne peux ignorer.

- Connaissances générales réduites : Moins de paramètres. Les modèles légers peinent avec les tâches nécessitant une vaste culture générale. C’est leur talon d’Achille.

- Perte de précision : Les techniques pour réduire les modèles. Quantification (réduction de la précision numérique). Élagage (suppression des connexions). Elles peuvent entraîner une légère baisse de précision. Elle est parfois perceptible.

- Limites de la fenêtre contextuelle : Beaucoup de petits modèles ont des “fenêtres contextuelles” plus courtes. Ils ne peuvent pas retenir de longues conversations. Ou traiter des documents massifs. Pas aussi efficacement que les grands modèles.

2. Limitations cognitives et de raisonnement

Ils ne sont pas des super-cerveaux, pas encore.

- Faible raisonnement multi-étapes : Les modèles légers échouent fréquemment. Devant des puzzles mathématiques complexes. La déduction logique. La résolution de problèmes complexes. Qui demandent de diviser une tâche en plusieurs étapes séquentielles.

- Manque de capacités émergentes : Les grands modèles montrent souvent des capacités “émergentes”. Des sauts soudains de logique ou de créativité. Elles n’apparaissent tout simplement pas dans les architectures plus petites, plus rigides.

- Spécificité du domaine : Les petits modèles sont souvent spécialisés. Pour une seule tâche. Ils ne généralisent pas bien à de nouveaux sujets. Sans un réentraînement ou un affinage intensif.

3. Risques d’implémentation et de sécurité

Des obstacles subsistent.

- Complexité de l’optimisation : Créer un petit modèle performant. Ce n’est pas juste réduire un grand. Cela exige souvent une “distillation des connaissances” complexe. Ou un “entraînement conscient de la quantification”. Cela demande une expertise spécialisée.

- Fragilité des garde-fous de sécurité : Les modèles plus petits reçoivent souvent moins de tests de sécurité rigoureux. La recherche a montré que leurs garde-fous peuvent être contournés plus facilement. Que ceux des modèles “frontières”. Par exemple, en demandant au modèle d’être “sarcastique” ou “contraire à l’éthique”.

- Compatibilité matérielle : Tout le matériel ne supporte pas tous les types de modèles “réduits” de la même manière. Une quantification extrême (comme 4 bits) ne fonctionnera pas efficacement sur d’anciennes puces. Qui manquent d’instructions spécifiques pour les calculs de faible précision.