Je le sais, le monde des agents conversationnels est vaste. Choisir la bonne interface utilisateur pour votre projet LangGraph peut sembler une tâche herculéenne. Pourtant, c’est une décision capitale. Que votre ambition soit un simple prototype, une application prête pour la production, ou une interface générative hautement personnalisée, une solution existe. Je vous guide à travers les options les plus pertinentes, celles qui ont fait leurs preuves.

Le choix idéal dépend toujours de la maturité de votre projet et de vos besoins spécifiques. Je vois souvent des équipes se perdre dans le dédale des outils, mais pas vous. Restez focalisé sur l’objectif de votre agent. Mon expérience me dit qu’il existe un outil pour chaque étape de votre parcours.

Les Interfaces Incontournables pour Vos Agents LangGraph

Je vous présente mes préférées, ces outils qui simplifient grandement la vie des développeurs d’agents.

- Agent Chat UI : L’application officielle Next.js de LangChain, entièrement open-source. Elle excelle avec tout agent LangChain. Je l’adore pour son streaming en temps réel, sa visualisation des outils et son débogage “time-travel” (le fameux forking d’état). C’est un véritable couteau suisse pour la production.

- CopilotKit : Une bibliothèque open-source robuste pour React. Elle agit comme un pont transparent entre votre agent backend et votre frontend. Elle gère des fonctionnalités complexes, comme le “Human-in-the-Loop” (HITL), où l’agent sollicite l’approbation de l’utilisateur. Imaginez le pouvoir !

- Assistant-UI : Nombreux la citent comme la méthode la plus rapide pour créer une application de chat professionnelle ou un agent. Elle brille pour les interfaces conversationnelles à états, demandant moins de code personnalisé.

- Streamlit : La référence pour le prototypage rapide. Entièrement basée sur Python, elle offre des composants de chat prêts à l’emploi. Parfaite pour les preuves de concept, je l’utilise constamment pour mes premières idées.

- AG-UI : Un protocole et une fondation UI pour construire des interfaces d’agents sur mesure, vraiment immersives. Elle gère sans accroc le streaming multi-agents complexe et la synchronisation d’état.

- Gradio : Mon choix privilégié pour les démos 100% Python, facilement partageables. Idéal pour montrer rapidement un agent à l’œuvre.

Je crois fermement qu’une bonne interface ne se contente pas d’afficher du texte ; elle raconte une histoire, celle de votre agent. Elle doit être intuitive, performante et fiable. Pensez à l’expérience utilisateur dès le départ.

Comparaison des Approches Populaires

Je mets ces informations en tableau pour vous faciliter la tâche. Visualisez les différences d’un coup d’œil, c’est ce que je fais toujours pour mes projets.

| Outil UI | Langage Principal | Meilleur Cas d’Usage | Caractéristique Clé |

|---|---|---|---|

| Agent Chat UI | TypeScript / Next.js | Chat prêt pour la production | Débogage “time-travel” |

| CopilotKit | React | Copilotes intégrés aux applications | Déclencheurs Human-in-the-Loop |

| Streamlit | Python | Prototypage rapide | Aucun code frontend requis |

| Assistant-UI | React | Composants pré-construits | Déploiement rapide d’UIs agentiques |

| Gradio | Python | Démos ML/AI | Partage et déploiement simples |

Personnalisation Avancée : La Magie de l’UI Générative

Si vous visez une interface qui s’adapte dynamiquement aux réponses de l’agent – afficher une carte, une carte de réservation ou un graphique – LangGraph vous soutient avec l’UI Générative. J’utilise la méthode UI.push pour enregistrer des composants React directement dans un nœud du graphe. Le frontend les rend ensuite selon la logique de l’agent. C’est une révélation pour l’interactivité !

J’ai souvent vu des équipes penser que l’UI générative est de la science-fiction. Détrompez-vous, c’est une réalité puissante. Elle transforme une conversation textuelle en une expérience riche et visuelle. Votre agent ne parle plus seulement, il montre.

Solutions Low-Code et Full-Stack : Deux Chemins, Un Objectif

Je rencontre souvent des besoins variés, du “je veux un truc qui marche vite” au “j’ai besoin d’un contrôle total”. Voici comment j’aborde la construction d’une UI LangGraph, selon vos préférences techniques.

Solutions Low-Code (Idéales pour les Prototypes et MVPs Rapides)

Ces outils vous permettent de construire des interfaces fonctionnelles avec un minimum de code personnalisé, souvent via des constructeurs visuels glisser-déposer. Je les privilégie pour mes expérimentations.

- Langflow : C’est le constructeur visuel open-source par excellence pour LangChain et LangGraph. Son interface glisser-déposer pour les applications agentiques et RAG est un délice. Vous pouvez même exporter vos flux en Python.

- n8n : Un outil d’automatisation qui excelle pour connecter rapidement des applications. Bien qu’il ne soit pas nativement basé sur LangChain, il intègre des nœuds LangChain. C’est parfait pour présenter des preuves de concept à des parties prenantes non techniques.

- Flowise : Une alternative populaire à Langflow, concentrée sur les flux visuels open-source.

- Appsmith : Une plateforme low-code pour construire des outils internes, en se connectant à des bases de données et des API. Très efficace pour gérer des données sensibles avec des modèles d’IA auto-hébergés.

Le low-code, c’est comme avoir un super-pouvoir pour la vitesse. Vous matérialisez vos idées en un clin d’œil. C’est ma première étape pour valider une intuition avant d’investir massivement en développement. J’ai vu des projets décoller grâce à cette agilité.

Solutions Full-Stack (Meilleures pour la Production et la Personnalisation Poussée)

Pour une application robuste et évolutive, où vous maîtrisez chaque pixel, je recommande une architecture traditionnelle : un frontend React/Next.js associé à un backend Python/FastAPI. C’est là que je me sens vraiment aux commandes.

- CopilotKit : Spécifiquement conçu pour relier les agents LangGraph aux frontends React. Il gère des fonctionnalités complexes comme la logique Human-in-the-Loop et la synchronisation d’état partagé via des hooks comme `useCoAgent`.

- FastAPI + Next.js : Une architecture courante. Un backend Python FastAPI sert le workflow LangGraph via WebSockets ou SSE (Server-Sent Events) pour permettre le streaming en direct de la progression de l’agent et des logs vers un frontend Next.js. C’est une configuration solide comme le roc.

- Agent Studio : Un projet de démarrage prêt à cloner de Ylang Labs. Il fournit une interface de studio basée sur React spécifiquement pour les agents LangGraph.

Résumé Comparatif : Low-Code vs. Full-Stack

Je vous offre une dernière comparaison pour solidifier votre choix.

| Caractéristique | Low-Code (ex: Langflow/n8n) | Full-Stack (ex: React + FastAPI) |

|---|---|---|

| Vitesse | Configuration initiale rapide | Développement initial plus lent |

| Personnalisation | Limitée aux contraintes de la plateforme | Contrôle total sur chaque pixel |

| Idéal Pour | MVPs, outils internes, démos | Produits publics, branding complexe |

| Complexité | Faible barrière technique | Élevée (nécessite des connaissances React & API) |

Maintenant, explorons chaque outil plus en détail. Préparez-vous à plonger au cœur de l’action !

Agent Chat UI : L’Officielle

L’Agent Chat UI, c’est l’application Next.js open-source officielle de LangChain. Je l’ai trouvée conçue spécifiquement pour interagir avec tout serveur LangGraph utilisant une clé de messages. Elle comble le fossé entre les backends agentiques complexes et une interface conversationnelle conviviale.

Pour moi, c’est la base, le point de départ évident quand on veut quelque chose de “LangChain-native”. Elle offre des fonctionnalités que je trouve essentielles pour un développement sérieux.

Fonctionnalités Clés

- Time-Travel & Forking : Je peux inspecter les points de contrôle passés d’une conversation et “forker” à partir de n’importe quel point. Cela me permet de tester différentes issues d’agent. Une vraie machine à remonter le temps pour le débogage.

- Human-in-the-Loop (HITL) : Elle détecte automatiquement quand un graphe est interrompu. Elle fournit une interface intuitive pour que les utilisateurs puissent examiner, modifier ou approuver les appels d’outils. Un garde-fou indispensable pour les actions critiques.

- Inspection d’État : Je peux visualiser l’état complet du thread de mon application LangGraph à chaque étape d’exécution. C’est crucial pour un débogage efficace.

- Support de l’UI Générative : Elle est capable de rendre des composants React personnalisés directement dans le chat. Il suffit de les enregistrer via la méthode

UI.pushdans mes nœuds de graphe.

Premiers Pas

Vous pouvez utiliser la version hébergée pour des tests immédiats, ou la faire tourner localement pour une personnalisation poussée. Je préfère le local pour une maîtrise totale.

npx create-agent-chat-app

# ou

git clone https://github.com/langchain-ai/agent-chat-ui.git

cd agent-chat-ui

pnpm install

pnpm devUne fois lancée (sur http://localhost:3000), vous devrez fournir :

- URL de déploiement : L’URL de votre serveur LangGraph local (ex:

http://localhost:2024) ou de production. - ID d’Assistant/Graphe : Le nom spécifique du graphe défini dans votre

langgraph.json. - Clé API LangSmith : Requise uniquement lors de la connexion à des serveurs distants/déployés.

Agent Chat UI vs. LangGraph Studio

Bien que les deux soient des outils officiels, ils servent des objectifs distincts. Je les vois comme des frères, mais chacun avec sa spécialité.

- LangGraph Studio : Principalement un IDE de développement et de débogage. Il offre une inspection visuelle profonde du graphe et une manipulation d’état pendant la phase de construction.

- Agent Chat UI : Un frontend axé sur le déploiement. Il est destiné à être l’interface finale avec laquelle vos utilisateurs finaux interagissent, bien qu’il conserve de nombreuses fonctionnalités de débogage pour les développeurs.

Mettre en Production l’Agent Chat UI

Pour “productionnaliser” l’Agent Chat UI, je déplace toujours les clés API sensibles (comme LANGSMITH_API_KEY) du côté client vers un proxy côté serveur. Cela empêche les utilisateurs d’inspecter mon code frontend pour trouver les identifiants et protège contre les attaques par injection de prompt qui pourraient tenter d’exfiltrer des variables d’environnement.

Stratégie d’Implémentation : API Passthrough

La façon standard de sécuriser cette UI est d’utiliser un package API Passthrough. Il agit comme un intermédiaire entre le navigateur de l’utilisateur et mon serveur LangGraph.

- Configurer le Proxy Backend : Dans un environnement Next.js, je crée une route API (généralement à

/api/langgraph/[[...path]]) qui capture toutes les requêtes de chat entrantes. Cette route :- Intercepte la requête avant qu’elle ne quitte mon serveur.

- Injecte ma

LANGSMITH_API_KEYsecrète dans les en-têtes de la requête. - Transmet la requête authentifiée à l’URL de déploiement de ma production LangGraph.

- Définir les Variables d’Environnement de Production : Je mets à jour mon environnement de production (par exemple, Vercel ou Docker) avec ces variables spécifiques pour contourner le formulaire de configuration frontend et sécuriser la connexion :

LANGSMITH_API_KEY: Ma clé secrète (gardée uniquement côté serveur).LANGGRAPH_API_URL: L’URL réelle de mon serveur LangGraph déployé (par exemple,https://my-agent.langgraph.app).NEXT_PUBLIC_API_URL: Je le définis sur le point d’extrémité API de mon site web (par exemple,https://your-site.com). Cela indique au frontend de communiquer avec mon proxy au lieu de LangGraph directement.NEXT_PUBLIC_ASSISTANT_ID: L’ID de mon graphe depuis monlanggraph.json.

Checklist de Sécurité pour la Production

- Utiliser des Composants Serveur : Chaque fois que possible, j’utilise les Composants Serveur de Next.js pour récupérer des données, car ils n’exposent jamais les clés au bundle JavaScript côté client.

- Restreindre l’Accès : J’implémente une authentification (comme Clerk ou NextAuth) sur ma route proxy. Seuls les utilisateurs connectés peuvent déclencher l’agent.

- Clés à Portée Limitée : Si j’utilise LangSmith, j’utilise des clés de déploiement à portée limitée. Elles n’ont la permission d’exécuter que des assistants spécifiques plutôt qu’un accès complet au compte.

CopilotKit : L’Assistant Intégré

CopilotKit est mon choix le plus robuste si vous voulez intégrer votre agent LangGraph dans une application React existante en tant que “Copilote” plutôt qu’une simple fenêtre de chat autonome. Il agit comme un pont, synchronisant l’état de votre agent backend avec votre UI frontend en temps réel.

Ce n’est pas juste un chat. C’est un compagnon intelligent qui vit DANS votre application. Je trouve que c’est une distinction cruciale qui ouvre des portes inattendues pour l’interactivité.

Pourquoi C’est un Choix “Production”

Contrairement à une UI de chat basique, CopilotKit permet à votre agent d’interagir avec l’application elle-même. L’agent peut lire le contenu de la page actuelle ou cliquer sur des boutons pour l’utilisateur.

- Intégration Centrale :

useCoAgent: Le hookuseCoAgentest le “ciment” de LangGraph. Il gère automatiquement le streaming et la synchronisation d’état.import { useCoAgent } from "@copilotkit/react-core"; const { state, status } = useCoAgent({ name: "my_langgraph_agent", // Doit correspondre au nom de votre backend initialState: { messages: [] } }); - Human-in-the-Loop (HITL) : CopilotKit simplifie la partie la plus délicate de LangGraph : les interruptions. Si mon graphe atteint un nœud qui nécessite l’approbation de l’utilisateur (comme “Confirmer l’achat”), CopilotKit peut déclencher automatiquement un modal ou un formulaire React personnalisé sur le frontend pour recueillir cette entrée. C’est une danse élégante entre l’agent et l’humain.

- UI Générative (Composants Adaptatifs) : Je peux définir des composants React que l’agent “rend” dans le chat. Si l’agent fait des recherches de voyage, il peut afficher un composant “Carte de Vol” au lieu d’un simple texte. C’est visuel, c’est puissant.

import { CopilotChat } from "@copilotkit/react-ui"; <CopilotChat labels={{ title: "AI Assistant", initial: "Comment puis-je vous aider à gérer votre tableau de bord aujourd'hui ?", }} />

Mettre CopilotKit en Production

Pour le sécuriser en production, j’utilise une URL d’exécution (Runtime URL) :

- Backend : J’héberge mon agent LangGraph (via LangGraph Cloud ou un serveur FastAPI auto-hébergé).

- Frontend : Je configure le fournisseur CopilotKit pour qu’il pointe vers un point d’extrémité backend sécurisé. Ce dernier vérifie les sessions utilisateur avant de transmettre les requêtes à l’agent.

<CopilotKit runtimeUrl="/api/copilotkit">

<App />

</CopilotKit>Astuce de Comparaison :

- J’utilise l’Agent Chat UI si je veux une expérience dédiée, plein écran, à la ChatGPT.

- J’opte pour CopilotKit si je cherche un assistant intégré qui connaît le contexte de mon tableau de bord logiciel.

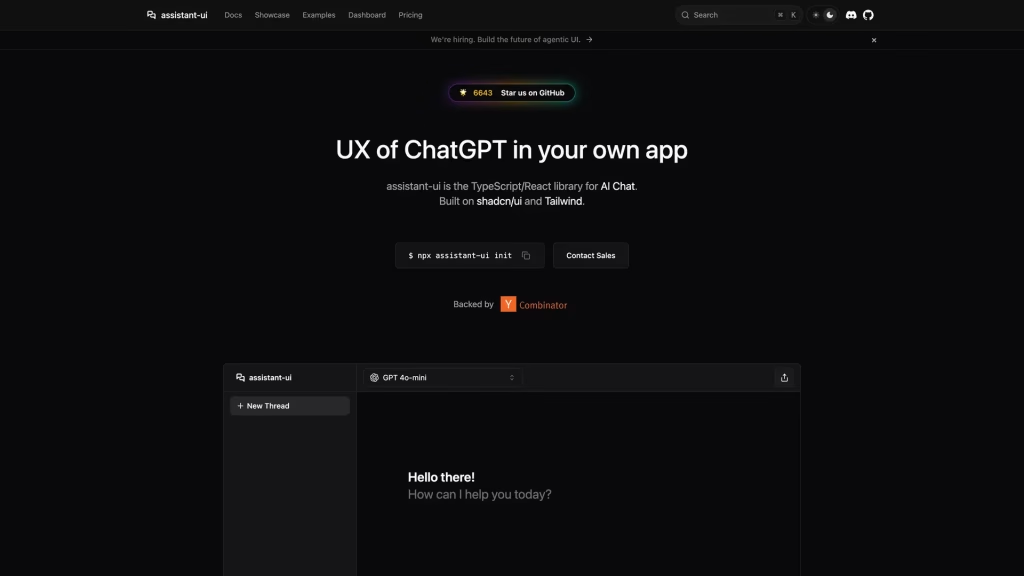

Assistant-UI : La Boîte à Outils Headless

Assistant-UI est un toolkit React “headless” conçu spécifiquement pour construire des interfaces de chat IA de qualité production. Je le considère comme un partenaire officiel de LangChain, offrant une intégration profonde avec LangGraph Cloud pour gérer des conversations agentiques à plusieurs tours, avec gestion d’état.

Quand la liberté de design est ma priorité, c’est vers Assistant-UI que je me tourne. Le terme “headless” n’est pas qu’un mot à la mode ; il signifie un contrôle total sur l’apparence.

Pourquoi Choisir Assistant-UI ?

Alors que d’autres UIs se concentrent sur un seul composant “drop-in”, Assistant-UI fournit des blocs de construction modulaires (Thread, Message, Composer). Je peux les styliser avec mon propre CSS ou les thèmes shadcn/ui.

- Runtime LangGraph Natif : Il est livré avec un adaptateur dédié

@assistant-ui/react-langgraph. Il reflète la logique de LangGraph, incluant un support natif pour le streaming, les interruptions et la persistance des threads. - UI d’Approbation : Il fournit des modèles pré-construits pour les workflows Human-in-the-Loop. Les utilisateurs peuvent examiner et approuver les appels d’outils (par exemple, confirmer une transaction boursière) directement dans la bulle de chat.

- UI Générative : Je peux enregistrer des composants React sur le frontend et demander à mon agent LangGraph de les “pousser” dans la conversation pour afficher du contenu riche comme des graphiques ou des cartes.

- Performance : Il est optimisé pour le streaming haute vitesse. Il évite les problèmes d’UI courants comme le “scintillement” pendant la génération de jetons.

Démarrage Rapide avec LangGraph

Je peux démarrer un nouveau projet avec le template officiel pour le voir en action immédiatement :

Générer un projet :

npx create-assistant-ui@latest -t langgraph my-appConfigurer l’environnement :

J’ajoute mes détails de connexion à .env.local :

NEXT_PUBLIC_LANGGRAPH_API_URL: L’URL de mon LangGraph Cloud ou studio local.NEXT_PUBLIC_LANGGRAPH_ASSISTANT_ID: L’ID du graphe de monlanggraph.json.

Lancer :

npm run devComparaison : Assistant-UI vs. CopilotKit

- Assistant-UI est la meilleure option si je veux construire une application de chat autonome, hautement personnalisée, avec un contrôle profond sur le flux de conversation et le rendu des messages.

- CopilotKit est préférable si je construis un assistant intégré à l’application. Il doit interagir avec l’état global de l’application et les éléments d’interface utilisateur en dehors de la boîte de dialogue de chat.

Streamlit : Le Prototypage à la Vitesse de l’Éclair

Streamlit est le standard de l’industrie pour le prototypage rapide d’agents LangGraph car il est purement Python. Je l’utilise constamment. Il me permet de construire une interface web fonctionnelle pour mes graphes à états sans écrire une seule ligne de HTML, CSS ou JavaScript.

Pour moi, c’est le point de départ idéal. L’idée naît, je la code en Python, et elle est déjà visible sur le web. C’est magique pour la validation rapide.

Pourquoi Streamlit est Excellent pour LangGraph

- Éléments de Chat Intégrés : J’utilise

st.chat_messageetst.chat_inputpour construire rapidement des boucles de conversation. Elles ressemblent et se comportent comme ChatGPT. - Gestion d’État : Je peux refléter les points de contrôle persistants de LangGraph dans

st.session_state. Cela assure que l’historique de la conversation ne disparaît pas lorsque la page se rafraîchit. - Visualisation : Puisque LangGraph est un graphe dirigé, j’utilise Streamlit pour afficher des diagrammes visuels du chemin de raisonnement de mon agent. Des outils comme

graphvizou l’intégrationMermaidsont mes amis ici. - Outil de Débogage : Je l’emploie souvent pour construire des tableaux de bord “internes” pour les développeurs. Ils peuvent surveiller les performances de l’agent, l’utilisation des outils et les coûts des jetons en temps réel.

Obstacles Techniques Clés

Bien que Streamlit soit rapide, il présente des défis spécifiques lorsque je travaille avec des workflows agentiques complexes :

- Streaming Asynchrone : LangGraph utilise souvent l’

asyncpour le streaming de jetons. Streamlit est principalement synchrone. Je dois utiliserasyncio.run()ou des boucles de streaming spécifiques pour éviter que l’UI ne “gèle” pendant que l’agent réfléchit. - Human-in-the-Loop (HITL) : Implémenter des “interruptions” (où l’agent attend l’approbation de l’utilisateur) peut être délicat. J’utilise généralement des placeholders

st.empty()ou une logique conditionnellest.button()pour suspendre le script et attendre l’entrée de l’utilisateur avant de reprendre le graphe.

Architecture Recommandée

Pour un prototype professionnel, j’utilise le modèle suivant :

- Mémoire : J’utilise le

SqliteSaverde LangGraph pour la persistance réelle du graphe. Je le synchronise avecst.session_statepour la couche UI. - Streaming : J’implémente une fonction générateur qui produit des chunks de

graph.stream(). J’utilisest.write_stream(disponible dans les versions plus récentes de Streamlit) pour cet effet de “frappe”. - Déploiement : J’héberge facilement via Streamlit Community Cloud ou Snowflake pour les cas d’utilisation en entreprise.

Quand Passer à Autre Chose que Streamlit

Je passe à une UI basée sur React (comme Agent Chat UI ou Assistant-UI) si :

- J’ai besoin d’animations très complexes ou de layouts de bulles de messages personnalisés.

- Je construis pour des milliers d’utilisateurs simultanés (le modèle “rerun on every interaction” de Streamlit peut devenir un goulot d’étranglement à grande échelle).

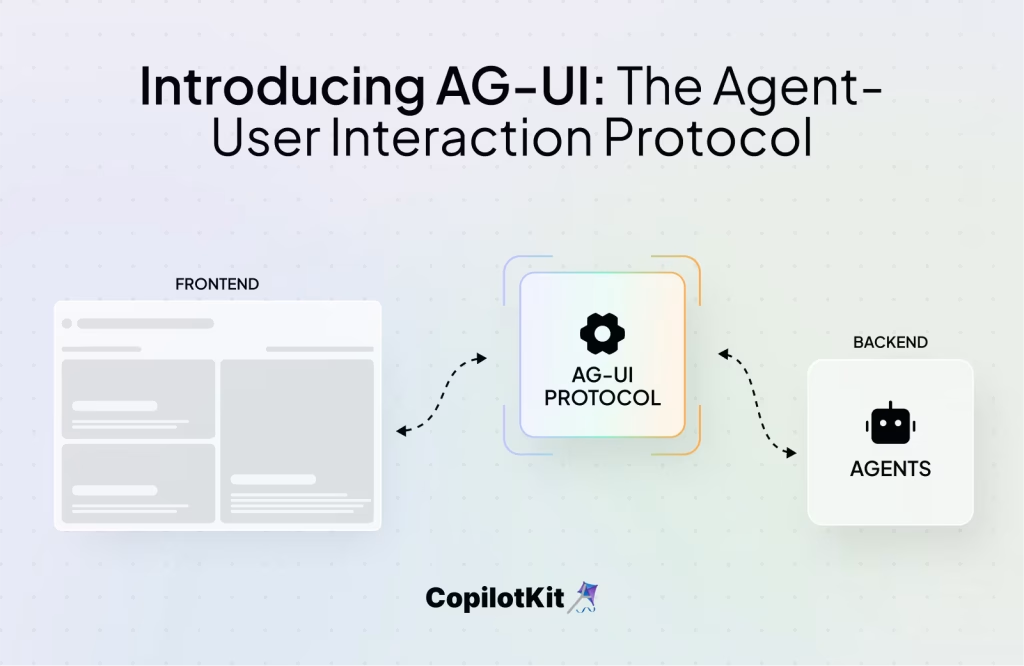

AG-UI : Le Protocole de Communication

AG-UI (Agent-User Interaction Protocol) est un protocole open-source, basé sur les événements. Il standardise la manière dont les agents IA comme LangGraph communiquent avec les applications frontend.

Ce n’est pas une “UI” que j’installe, c’est une couche de communication. Il me permet de brancher n’importe quel agent compatible AG-UI dans n’importe quel frontend compatible AG-UI (comme CopilotKit) sans écrire de logique WebSocket ou API personnalisée pour chaque nouvelle fonctionnalité.

Je vois AG-UI comme le langage secret que les agents et les interfaces parlent entre eux. Une fois que vous le comprenez, tout devient plus fluide, plus interopérable. C’est l’avenir de l’intégration agentique.

Capacités Clés pour LangGraph

- Streaming Basé sur les Événements : Au lieu d’attendre une réponse complète, AG-UI diffuse plus de 17 types d’événements distincts. Cela inclut

TEXT_MESSAGE_CONTENT,TOOL_CALL_STARTetRUN_FINISHED. - Synchronisation d’État Bidirectionnelle : Il synchronise automatiquement l’état interne de l’agent avec l’état du frontend. Il utilise des événements

STATE_SNAPSHOTetSTATE_DELTA. - Human-in-the-Loop (HITL) : Support natif des workflows d’approbation. L’agent se met en pause et attend la confirmation de l’utilisateur avant d’exécuter un appel d’outil.

- Interopérabilité Standardisée : Il complète d’autres protocoles comme MCP (Model Context Protocol) et A2A (Agent-to-Agent). Alors que MCP donne des outils aux agents, AG-UI porte ces interactions à l’écran de l’utilisateur.

Implémentation avec LangGraph

Pour utiliser AG-UI avec mon projet LangGraph, j’utilise généralement un adaptateur. Il traduit les événements internes de LangGraph en événements AG-UI.

- Backend (Python/FastAPI) : J’utilise l’

AGUIAdapterpour envelopper mon agent LangGraph. Cela active un point d’extrémité qui diffuse des événements AG-UI standard. - Frontend (React/Next.js) : J’utilise le SDK CopilotKit pour écouter ces événements. Des hooks comme

useCoAgentgèrent le gros du travail de gestion d’état et de mises à jour de l’interface utilisateur. - Composants UI Personnalisés : Je peux enregistrer des composants React spécifiques. Ils se déclenchent automatiquement lorsque l’agent émet un événement lié à un outil spécifique, créant une UI Générative transparente.

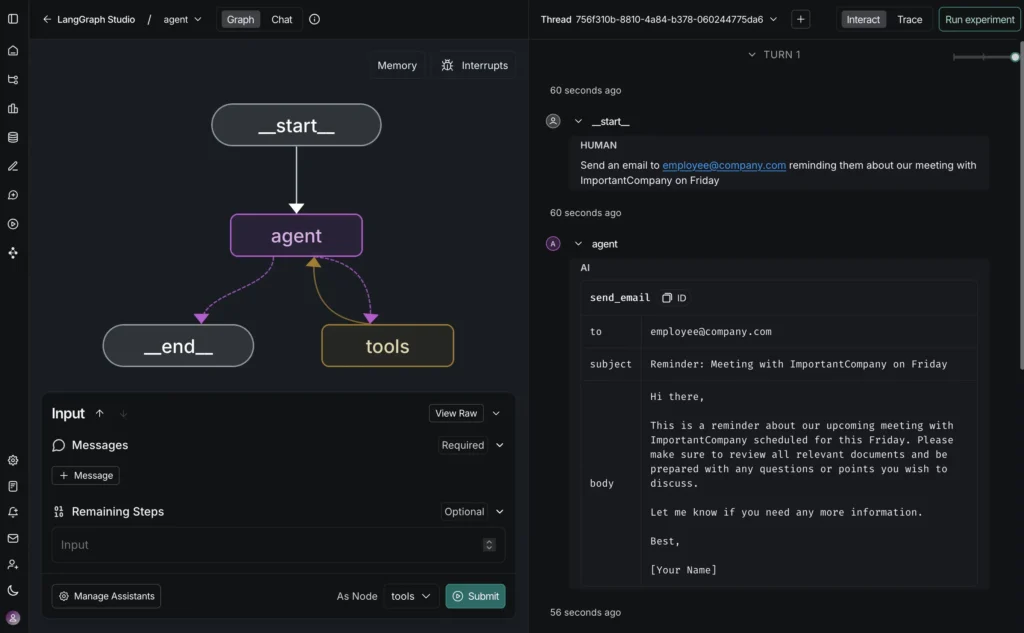

LangGraph Studio : L’IDE Visuel des Agents

LangGraph Studio est un environnement de développement intégré (IDE) spécialisé. Je l’ai conçu explicitement pour construire, visualiser et déboguer des agents IA. Il fournit une interface visuelle qui complète mon éditeur de code. Il montre comment l’information circule à travers mes nœuds de graphe en temps réel.

Pour moi, Studio est mon laboratoire. C’est là que je dissèque mes agents, observe leurs pensées, et perfectionne leurs comportements. C’est un outil indispensable pour la sérénité du développeur.

Capacités Clés

- Débogage Visuel : Je peux visualiser l’architecture de mon graphe et observer le flux d’exécution pendant que les nœuds traitent les données.

- Débogage “Time-Travel” : J’inspecte l’état exact à n’importe quel point de l’historique de l’agent. Je peux “forker” à partir de là pour tester une logique alternative sans réexécuter toute la séquence.

- Manipulation d’État : Je modifie l’état de l’agent ou les réponses des outils en cours d’exécution. Cela me permet de simuler différents scénarios ou de corriger le tir.

- Rechargement à Chaud (Hot Reloading) : Il détecte automatiquement les changements de code dans mon éditeur. Il met à jour le graphe en cours d’exécution. L’ingénierie des prompts et les tests de logique sont bien plus rapides.

- Human-in-the-Loop : Je gère visuellement les “interruptions”. Je peux approuver ou modifier les actions de l’agent avant qu’elles ne s’exécutent.

LangGraph Studio vs. Agent Chat UI

Bien qu’ils se ressemblent, ils servent des étapes de développement distinctes. Je les considère comme des outils complémentaires.

- LangGraph Studio : Un outil de développement. Il se concentre sur la transparence technique. Il me permet de voir les logs, d’inspecter les variables cachées et de manipuler l’état du graphe.

- Agent Chat UI : Un template orienté utilisateur. Il est conçu pour être déployé comme une application de production. Les utilisateurs finaux interagissent avec une interface de chat épurée.

Comment l’Utiliser

- Développement Local : Je peux le faire fonctionner via l’application de bureau LangGraph Studio (macOS uniquement) ou via l’interface web LangSmith pour une version web multiplateforme.

- Configuration : Il nécessite un fichier

langgraph.jsondans le répertoire de mon projet. Il indique au Studio où trouver mes graphes et mes variables d’environnement. - Intégration : Il fonctionne de manière transparente avec LangSmith pour le traçage et l’observabilité. Je peux récupérer les traces de production dans mon Studio local pour le débogage.

Le Fichier `langgraph.json`

Le fichier langgraph.json est le fichier de configuration central requis pour LangGraph Studio et LangGraph Cloud. Il leur permet de découvrir vos graphes, d’installer les dépendances et de charger les variables d’environnement.

Modèle `langgraph.json` Standard

Créez ce fichier dans le répertoire racine de votre projet pour activer le débogage local dans le Studio.

{

"dependencies": ["."],

"graphs": {

"my_agent": "./agent.py:graph"

},

"env": ".env",

"store": {

"index": {

"embed": "openai:text-embedding-3-small",

"dims": 1536,

"fields": ["$"]

}

}

}Détail des Champs Clés

dependencies: Spécifie où trouver mes exigences Python. Utiliser["."]indique au Studio de chercher unrequirements.txtoupyproject.tomldans le dossier actuel.graphs: Une cartographie des IDs d’assistants vers leur emplacement de code. Le format estchemin/vers/fichier.py:nom_variable, oùnom_variableest mon objetStateGraphcompilé.env: Chemin vers mon fichier d’environnement local contenant les clés sensibles commeOPENAI_API_KEYouTAVILY_API_KEY.store(Optionnel) : Configure une recherche sémantique intégrée pour la mémoire de mon agent. Le paramètreindex.fieldsdétermine quelles parties de mes documents sont recherchables.http(Optionnel) : Utilisé pour gérer la confidentialité. Il contrôle quels en-têtes (comme les IDs utilisateur) sont passés du frontend au runtime de mon graphe.

Exemple de Structure de Projet

Pour que la configuration ci-dessus fonctionne, mon dossier doit être organisé comme suit :

my-agent-project/

├── .env # Clés API et secrets

├── requirements.txt # Dépendances Python

├── agent.py # Mon code StateGraph

└── langgraph.json # Ce fichier de configurationUne fois ce fichier enregistré, je peux lancer le Studio en exécutant langgraph dev dans mon terminal. Il détecte automatiquement cette configuration.

A lire aussi — Hermes Agent : Décryptage Complet, Installation, Sécurité & Documentation

Gradio : Les Démos Python Instantanées

Gradio est la bibliothèque que je préfère pour créer des démos d’agents LangGraph partageables, uniquement en Python. Elle est particulièrement efficace pour construire rapidement des interfaces de chatbot qui supportent le streaming, la persistance d’état et des types de données complexes comme l’audio.

Si je veux montrer mon agent à un public non technique en cinq minutes, Gradio est ma baguette magique. C’est simple, c’est direct, ça marche.

Modèles d’Intégration Clés

- Interface Chatbot : J’utilise

gr.ChatInterfacepour l’implémentation la plus simple. Je peux envelopper mes appelsgraph.stream()ougraph.astream()de LangGraph dans une fonction qui envoie des morceaux à l’interface utilisateur. - Persistance d’État : Le composant

gr.Statede Gradio peut stocker les fils de conversation et les points de contrôle. Cela garantit que l’état persistant de LangGraph reste intact sur plusieurs tours utilisateur. - Contenu en Streaming : Pour montrer l’agent “réfléchir”, j’écris une fonction générateur. Elle produit le dernier état du graphe. C’est utile pour afficher les appels d’outils, les logs et les réponses finales au fur et à mesure qu’ils se produisent.

- Human-in-the-Loop (HITL) : Je peux implémenter des points d’arrêt en demandant à mon graphe de se mettre en pause. J’utilise ensuite les boutons d’entrée de Gradio pour fournir le feedback ou l’approbation nécessaire avant que le graphe ne reprenne.

Comparaison d’Implémentation : Gradio vs. Streamlit

Bien que les deux soient natifs de Python, ils excellent dans des domaines différents. Je les utilise pour des cas distincts.

- Gradio : Meilleur pour partager une URL publique en quelques secondes (via

share=True). Il a un support intégré pour l’écosystème Hugging Face. - Streamlit : Plus adapté pour construire des tableaux de bord internes complexes et des outils multi-pages qui nécessitent plus de contrôle sur la mise en page qu’une fenêtre de chat standard.

Démarrage Rapide

Vous pouvez utiliser des templates pré-construits pour sauter la configuration :

- Gradio-LangGraph Template : Il propose l’historique, les appels d’outils et le streaming dès la sortie de la boîte.

- LangGraph, FastAPI, et Gradio Trio : Une architecture prête pour la production. FastAPI sert la logique du graphe à un frontend Gradio.

Personnalisation Avancée : L’UI Générative, le Saint Graal

L’UI Générative, c’est le “Saint Graal” des interfaces d’agents. Au lieu d’envoyer seulement du texte, mon agent LangGraph envoie des instructions ou des données. Celles-ci déclenchent des composants React spécifiques sur le frontend (comme un graphique boursier en direct, un calendrier de réservation ou un traqueur de vol).

J’ai vu cette technologie transformer des conversations banales en expériences immersives. Votre agent ne se contente plus d’informer, il agit visuellement, il crée une réalité interactive.

Comment Ça Marche : Le Modèle “Push”

Dans un chat standard, l’agent envoie une chaîne de caractères. Dans l’UI Générative, la sortie du nœud de l’agent inclut une clé spécifique. Le frontend la reconnaît comme un “déclencheur de composant UI”.

- Backend (LangGraph) : Un nœud décide qu’un visuel est nécessaire (par exemple, après un appel d’outil). Il renvoie une mise à jour d’état contenant des noms de composants et des props.

- Frontend (React) : Un “Registre de Composants” mappe ces noms à des composants React réels. Lorsque le flux de messages rencontre une balise de composant, il rend l’UI au lieu du texte.

Modèles d’Implémentation

Je les utilise pour structurer ma pensée quand je conçois une UI générative.

| Fonctionnalité | Description |

|---|---|

| UI pilotée par les outils | Le modèle le plus courant. Lorsqu’un outil comme `get_weather` renvoie des données, l’UI rend automatiquement un composant `WeatherCard`. |

| Synchronisation avec l’état | Le frontend utilise des hooks (comme `useCoAgent` dans CopilotKit) pour “surveiller” l’état de LangGraph. Si `state.show_map` devient vrai, la carte apparaît. |

| Composants interactifs | Le composant UI n’est pas statique ; il peut renvoyer des données au graphe (par exemple, cliquer sur un siège sur une carte d’avion met à jour le prochain tour de l’agent). |

Les Meilleurs Outils pour l’UI Générative

- Assistant-UI : Il offre l’implémentation la plus propre via les “Renderers”. Je définis un

MessagePartRendererqui intercepte les appels d’outils et affiche un composant React personnalisé au lieu du JSON brut. - CopilotKit : Il utilise une propriété

renderdans son SDK. Je peux littéralement dire à l’agent : “Quand tu appelles cet outil, utilise ce composant React spécifique pour afficher le résultat.” - Vercel AI SDK : Le pionnier de ce modèle. Il utilise

streamUIpour envoyer des composants React rendus côté serveur directement via le réseau. Cependant, l’intégrer avec la machine à états de LangGraph demande un peu plus de “glue code”.

Le Lien “Human-in-the-Loop”

L’UI Générative est la plus puissante pour les approbations. Au lieu de taper “oui”, l’agent génère une carte “Confirmer la transaction” avec des boutons “Approuver” et “Annuler”. Cliquer sur “Approuver” envoie une commande au thread LangGraph pour reprendre l’exécution. C’est une interaction fluide, intuitive.

Chez DeepLearn Academy, nous proposons des cours sur les agents et l’automatisation pour les professionnels. Si vous souhaitez apprendre le workflow complet de LangGraph, depuis les bases, contactez notre équipe. Je suis là pour vous accompagner dans votre parcours !