L’IA avance à pas de géant. Je vous présente GPT-5.5, nom de code interne “Spud”. C’est le tout dernier modèle d’IA de pointe d’OpenAI. Nous l’avons lancé le 23 avril 2026. Les dirigeants d’OpenAI le décrivent comme un “saut générationnel”. C’est notre premier grand modèle pré-entraîné en près de deux ans. Préparez-vous à une nouvelle ère de l’intelligence artificielle !

GPT-5.5 “Spud” : Le Nouveau Géant d’OpenAI

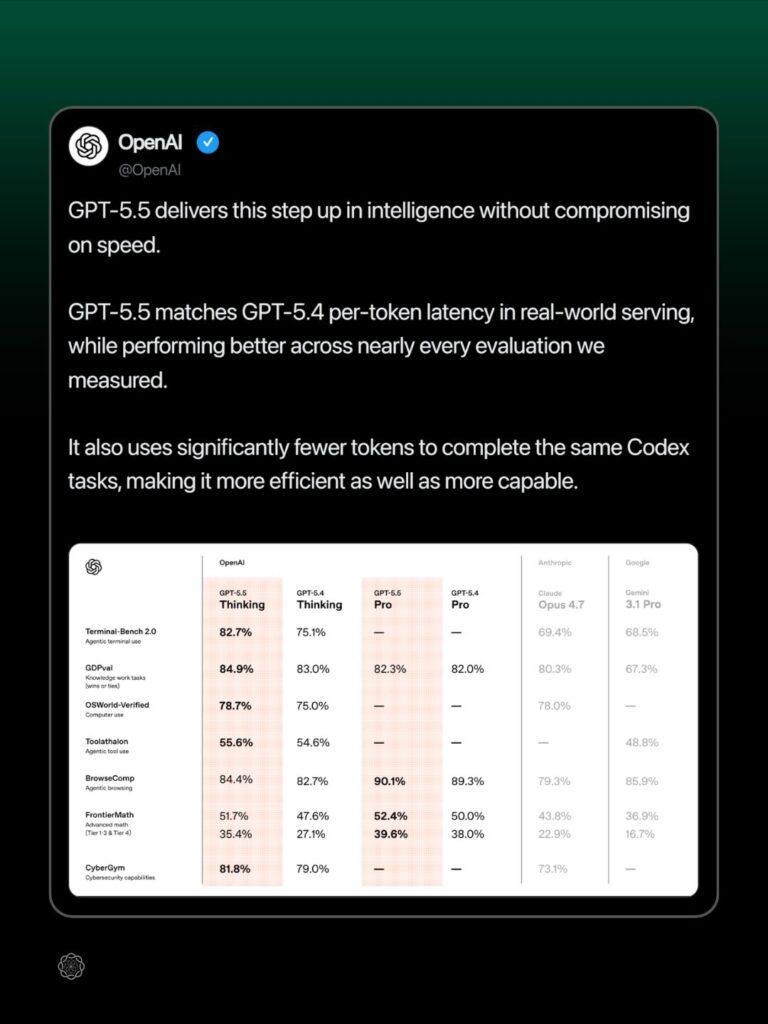

GPT-5.5 excelle. Il domine 14 grands benchmarks. Pensez à Claude 4.7 Mythos. GPT-5.5 le surpasse en particulier pour le travail économique (GDPval). Il brille aussi en mathématiques complexes. Son utilisation autonome de l’ordinateur est un atout majeur.

Il interagit de façon plus évoluée avec les systèmes d’exploitation. C’est un bond par rapport à GPT-5.4. Le modèle est “plus intelligent dès le départ”. Il a besoin de moins de jetons pour des réponses précises. Il intègre des garde-fous stricts.

Cela prévient les usages malveillants en cybersécurité. Des versions dédiées existent pour les professionnels de confiance. Je parle de GPT-5.4-Cyber.

Le Contexte de sa Révélation

Des mois de spéculation ont précédé cette annonce. Je me suis souvent demandé si “Spud” deviendrait GPT-5.5 ou GPT-6. Sa sortie coïncide avec un virage stratégique chez OpenAI. Nous nous concentrons davantage sur les solutions d’entreprise. Des outils créatifs, comme Sora, ont été abandonnés. C’est un signe clair de notre nouvelle direction.

GPT-5.5 “Spud” incarne un changement. Nous passons à l’intelligence agentique. Le modèle agit comme un partenaire. Ce n’est plus seulement un chatbot. Il navigue des flux de travail complexes de manière autonome. Imaginez : il fait des recherches. Il vérifie ses propres données. Il exécute des tâches techniques en plusieurs étapes. C’est impressionnant.

Performances et Benchmarks Détaillés

GPT-5.5 a repris la première place. Il s’illustre dans plusieurs classements clés. Surtout ceux qui mesurent l’utilité réelle. C’est ce qui compte le plus.

- Terminal-Bench 2.0 : Il a obtenu 82,7 % sur les workflows complexes en ligne de commande. C’est un bond important. GPT-5.4 avait 75 %.

- GDPval : Nous avons atteint 84,9 % dans les travaux de connaissance de haut niveau. Cela inclut la recherche, l’analyse de données et la création de documents. Il surclasse tous ses concurrents actuels.

- Mathématiques : Il a fait preuve d’un raisonnement avancé. Il a aidé à une nouvelle preuve mathématique. Cela concernait les nombres de Ramsey. Un logiciel formel l’a vérifiée plus tard.

- Codage : Il domine l’utilisation d’outils agentiques. Pourtant, des concurrents comme Claude 4.7 Mythos gardent une avance mince. Je parle du pure génie logiciel (SWE-Bench Pro). Ils sont aussi meilleurs pour le raisonnement sans outils.

Des Capacités Agentiques au Cœur de Codex

Le modèle s’intègre en profondeur à Codex. C’est la plateforme d’OpenAI pour l’utilisation autonome de l’ordinateur.

- Navigation Multi-Applications : Il peut passer d’un e-mail à une feuille de calcul. Il utilise aussi un navigateur web. Il accomplit un seul objectif. C’est ça la vraie autonomie.

- Clarté Conceptuelle : Les testeurs l’ont noté. GPT-5.5 comprend mieux l’architecture système. C’est mieux que les modèles précédents. Il refactorise de grandes bases de code. Il résout des conflits de fusion complexes en un seul passage.

- Efficacité : Il est plus intelligent. Pourtant, le modèle est plus “efficient en jetons”. Il résout souvent des tâches avec moins de jetons que GPT-5.4.

Tarification et Accès

Vous vous demandez comment y accéder ? Voici un aperçu :

| Niveau | Détails d’Accès |

|---|---|

| ChatGPT Plus | Comprend GPT-5.5 Thinking. La fenêtre contextuelle est souvent limitée pour les consommateurs. |

| Pro / Business | Inclut GPT-5.5 Pro. C’est une variante plus précise pour les tâches spécialisées. |

| API | 5 $ par million de jetons d’entrée / 30 $ par million de jetons de sortie (standard 5.5). La variante Pro coûte 30 $ / 180 $ par million de jetons. |

Une note importante : Il est déjà disponible dans ChatGPT et Codex. Mais le déploiement complet de l’API s’effectue par étapes. Nous voulons garantir le respect des garde-fous de sécurité. La prudence est notre maître-mot.

Le Mystère de “Spud” : Pourquoi ce Nom de Code ?

Le nom interne “Spud” interpelle. Il suit la tradition d’OpenAI. Nous utilisons des alias modestes pour nos grandes avancées. OpenAI n’a pas donné une raison officielle unique. Mais plusieurs interprétations ont émergé. Elles viennent de la communauté de l’IA.

« Un modèle si puissant qu’on l’a nommé… Patate ! C’est le contraste parfait. »

- Minimiser la Capacité : Le nom “Spud” (une humble pomme de terre) contraste fort avec la puissance du modèle. Il a été choisi pour maintenir un profil interne modeste. Les dirigeants ont ensuite parlé d’un “saut générationnel”. Il pourrait “accélérer l’économie”.

- La Métaphore de la “Puissance de la Pomme de Terre” : Des testeurs et chercheurs ont plaisanté. Ils ont évoqué l’expérience classique. On alimente une horloge avec une pomme de terre. Le modèle est si efficace qu’il réalise des bonds de raisonnement énormes. Il utilise beaucoup moins de “puissance” ou de jetons.

- Spéculation Interne sur S.P.U.D. : Certains chercheurs pensent que c’est un acronyme. Il signifierait “Scalable, Personalized, Ubiquitous Deployment”. Cela reflète sa conception. C’est un modèle “agentique” très efficace. On peut le déployer sur divers systèmes d’exploitation et appareils.

- Culture de Noms de Code Cohérente : OpenAI utilise souvent des mots simples. Ce sont des mots du quotidien. Pour nos projets internes, c’est une règle. Cela évite que les fuites ne paraissent trop dramatiques. Cela cache aussi l’architecture technique du projet avant le lancement.

Efficacité des Jetons et Performance Globale

GPT-5.5 “Spud” se concentre sur l’intelligence de pré-entraînement. Il résout les problèmes en un seul passage. Il ne dépend pas du “test-time compute”. Il ne génère pas de longues chaînes de jetons de raisonnement internes. C’est une approche révolutionnaire.

- Concision : Aux benchmarks d’Artificial Analysis, GPT-5.5 a atteint son score d’intelligence. Il a utilisé uniquement 22 millions de jetons. Les modèles de sa catégorie en utilisent 23 millions en moyenne.

- Efficacité des Tâches Codex : Pour les tâches d’ingénierie autonomes, Spud utilise autour de 40 % moins de jetons de sortie. Il atteint le même résultat que GPT-5.4.

- Mathématiques Complexes : Les premiers rapports sont formels. Spud utilise jusqu’à 80 % moins de jetons pour les maths avancées. Il maintient une précision record.

- Optimisation de l’Infrastructure : OpenAI a co-conçu le modèle avec des systèmes NVIDIA GB200/GB300. Spud lui-même a réécrit sa propre infrastructure de service. Cela a augmenté la vitesse de génération de jetons de 20 %.

Coûts Énergétiques et d’Inférence

L’efficacité a un prix. L’exigence matérielle sous-jacente reste élevée. Je l’admets.

- Consommation Électrique : Le modèle est plus efficient en jetons. Mais le matériel sous-jacent est gourmand. Des chercheurs estiment que la série phare GPT-5 consomme plus de huit fois l’énergie de GPT-4.

- Économie de l’API : Le coût par jeton de sortie dans l’API a doublé. C’est comparé à GPT-5.4. Les utilisateurs peuvent “atteindre le seuil de rentabilité”. Le modèle nécessite moins de jetons au total pour accomplir une tâche.

- Comparaison à Claude 4.7 Mythos : Mythos est un modèle de grande taille. Il compte 10 billions de paramètres. Il est conçu pour la profondeur. Mythos est leader en pure ingénierie logicielle (SWE-Bench Pro). Mais Spud est préféré souvent pour l’utilisation informatique agentique. Sa mise en œuvre est plus rapide. Il y a moins de friction de jetons.

Efficacité des Jetons & Benchmarks

Voyons cela de plus près :

| Modèle | Efficacité des Jetons (relative) | SWE-Bench Pro | Indice d’Intelligence |

|---|---|---|---|

| GPT-5.5 Spud | Élevée (40 % de jetons en moins dans Codex) | 58.6% | 57 |

| GPT-5.4 | Référence | 57.7% | — |

| Claude 4.7 Mythos | Faible (Actif Défensif Stratégique) | 77.8% | — |

| Claude Opus 4.7 | Modérée | 64.3% | — |

Ces données proviennent de VentureBeat et Artificial Analysis. Je les ai vérifiées pour vous.

Restez Connectés à l’Avant-Garde de l’IA — L’IA bouge vite. Vraiment très vite. Je vous invite à rester informé. Abonnez-vous à la DeepSkill Newsletter. Chaque lundi, je vous apporte les dernières actualités. Ne manquez rien !